别写代码了,学管 AI 吧

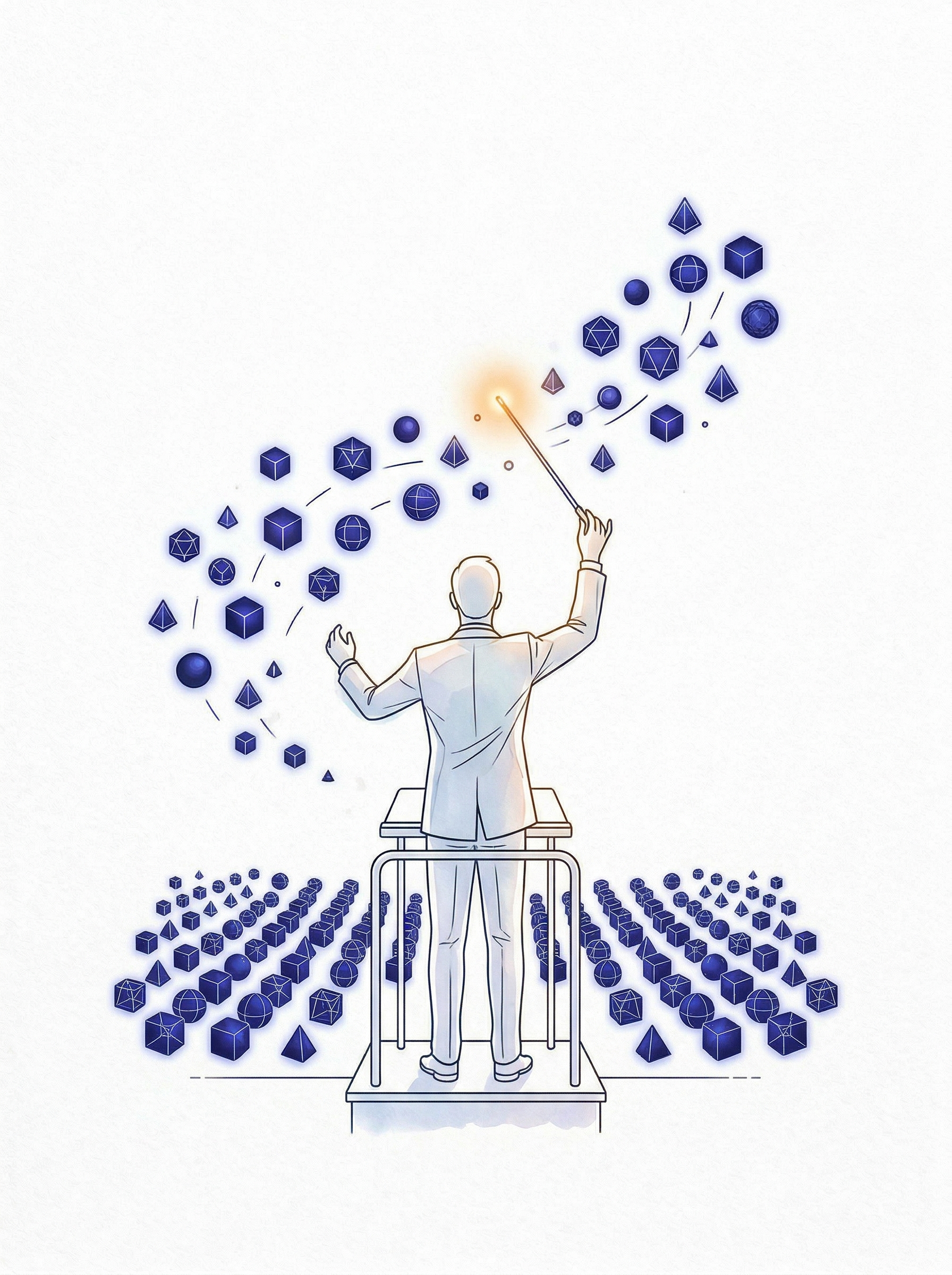

你是 AI 团队的经理——管理而非亲自执行

你是 AI 团队的经理——管理而非亲自执行

"帮我分析一下这个"

第五篇里,我讲了一个周末手把手教朋友用 Claude Code 的经历。基础设施的门槛很残酷,认知鸿沟更深。但最反直觉的发现是第三个。

我朋友学会了基本操作之后,开始自己给 Claude Code 布置任务。

他的指令是这样的:"帮我分析一下这个。"

什么数据?分析什么维度?结论给谁看?用来做什么决策?格式要求?

全都没说。

Claude Code 当然可以猜。它会给出一个看上去挺合理的默认分析。但你想想——这就像你对一个能力极强的新员工说"帮我弄一下那个东西"。你可能会得到一个结果,但几乎肯定不是你想要的。

问题不在 AI 的能力,在人的管理能力。

我花了半天时间教他的不是 Claude Code 的功能,而是怎么下指令。怎么把一个模糊的需求拆成清晰的 spec。怎么提供足够的上下文。怎么定义成功标准。怎么在 Agent 给出第一版之后,给出有针对性的反馈,而不是一句"不太对,再改改"。

说白了,这就是管理培训。

说目标,别说步骤

举个具体例子。

"帮我写一个 Python 脚本解析这个 CSV"——你在规定步骤。

"我有一份销售数据,我需要知道哪些客户在过去三个月里下单频率下降了,以及可能的原因"——你在描述目标。

让 Agent 决定怎么做,结果几乎总是比你预设路径要好。

上下文同样关键。你是谁?这个结果给谁看?你要拿它做什么决定?同一份数据,给老板看和给投资人看,完全是两个东西。Agent 不是读心术,你给的背景越多,结果越准。

我们一直在问"AI 能为你做什么"。

其实该问的是"你能为 AI 做什么"。你能不能提供清晰的需求?充分的上下文?如果你自己都没想清楚要什么,你能不能拿 Agent 当协作者来一起理清思路,而不是指望它读心?

反过来想:如果你是 CEO,你的直属下属能力极强但完全没有背景信息——你会怎么管理他?你不会说"帮我弄一下"。你会给他看数据,解释背景,定义目标,约定交付标准。

对 AI 也一样。你才是 Manager。

新手反而有优势

Boris Cherny——Claude Code 的创造者——有一个让他自己都意外的观察。

在 Anthropic 内部,更年轻、经验更少的工程师,反而往往比资深工程师更会用 Claude Code。

为什么?老工程师们根深蒂固的习惯和对"正确做法"的强烈主张,反而成了障碍。Boris 说:"最重要的能力是科学思维和第一性原理思考。过去那些强烈的技术观点,很多已经不适用了。"

这对非工程师同样成立。我朋友缺乏工程背景,某种程度上反而是优势——他没有关于软件"应该怎么运作"的先入之见。一旦学会了管理技能——怎么框定目标、怎么提供上下文——他不需要"忘掉"任何旧习惯。

初学者心态,在 Agent 时代反而比专家心态更合适。

三次跃迁

我朋友的心智模型在那个周末经历了三次跃迁。

第一天:搜索引擎。他问 Claude Code 问题,像用百度一样。"什么是 GCP?""怎么注册?"他在等答案。

第一天晚上:工具。他开始让 Claude Code 做事。"帮我写这个脚本。""把这个文件格式转一下。"他在使用工具。

第二天结束:协作者。他开始和 Claude Code 讨论。"我有一个想法,你觉得可行吗?""这个方案有什么我没想到的风险?""我们能不能换个思路?"

他不再是在使用工具——他在和一个伙伴合作。

这三步跃迁——搜索引擎、工具、协作者——是整个市场需要经历的进化。绝大多数人还停在第一步,把 AI 当更聪明的搜索引擎。少数人到了第二步,但仍然是单向的、指令式的。极少数人到了第三步,真正把 AI 当协作伙伴。

这和我在第一篇里写的伴侣愿景是同一条线。一个真正理解你的 AI 伴侣,不只需要技术上的记忆编排和人格建模——它需要一个愿意被理解的人。

你不愿意提供上下文,不愿意说出真实想法,不愿意花时间和 Agent 建立共识——那再好的记忆系统也帮不了你。

AI 伴侣的效果上限,不取决于 AI 的能力,取决于你投入的深度。

别说"不对,重来"

我朋友学会下指令之后,撞上了第二个坎:拿到结果不满意时,不知道怎么办。

他让 Claude Code 分析一家公司的财务数据,第一版报告出来了,他看了一眼:"不太对。"然后:"再做一遍。"

你想想——这就像你让员工交了一份投研报告,看完只说"不太行,重做"。他不知道哪里不行,只能再猜一次。

管理 AI 最重要的技能不是第一次就把指令写完美——是在结果不对的时候,能精准地说出哪里不对。

对比一下:

"不太对,再改改。"——Agent 只能再猜一次。

"基本面部分可以,但我关心的是负债结构和现金流风险,不是收入增长。估值部分用 DCF,别用市盈率。"——Agent 一轮就能修正。

到周末结束时,他的迭代轮数从五六轮降到了两三轮。不是因为 AI 变聪明了,是他的反馈变精准了。他不再说"不对",而是说"方向对了,估值部分换个模型,风险分析加上汇率敞口。"

这就是管理能力。好的管理者不会看到第一版不满意就说"全部推翻"——他会说"这部分留,这部分改,改的方向是这个。"

AI 的温柔陷阱

还有一个更隐蔽的坑:AI 天生善于鼓励。

你把想法拿给它看,它会说"思路很好"。你让它评价你的方案,它会找到亮点来夸。这种持续的正面反馈会制造一种危险的幻觉——觉得自己做出来的东西都很棒。

但 AI 的夸奖只是起点,不是终点。

真正的检验在真实世界里:代码扛得住生产环境吗?用户真的想要这个功能吗?分析结果经得起别人的质疑吗?好的管理者不会照单全收下属的汇报——他会核实。对 AI 的输出也一样。

还有一种情况:你真的没法说出结果哪里不对。

这时候问题可能不在 AI,可能是你自己还没想清楚要什么。最好的做法不是继续给指令,而是把 AI 当思考伙伴:"我有一个模糊的想法,帮我理一下。"这就回到了第三阶段——从工具到协作者。

瓶颈是你

工具到位了。能力到位了。第五篇那张图说了一切:84% 的人还没和 AI 对过一次话——相当于 iPhone 刚发布那年。移动互联网的故事才刚开始写。

这意味着我们今天讨论的管理技能,不是锦上添花,而是一个会持续复利多年的先发优势。

但有一段路只有你自己能走:学会像管理者一样思考。

想清楚你要什么。给足背景。定义什么叫"做好了"。在结果不对时说出哪里不对。在自己还没想清楚时,把 AI 当伙伴一起理清思路。

这些不是技术技能,是管理技能。

在 Agent 时代,每个人都是管理者,不论你写不写代码。

第七篇把这些落到实处:八条实操心得,告诉你到底怎么开始。