TPU 凭什么挑战英伟达

GPU 是一千个大厨,TPU 是一条流水线——两种计算哲学

GPU 是一千个大厨,TPU 是一条流水线——两种计算哲学

前几天听了一期硅谷101的播客,嘉宾是一位前谷歌 TPU 工程师 Henry,在谷歌干了六年,深度参与了 V7(Ironwood)和 V8 的研发。

我对硬件一直有兴趣但不算深入。听完这两个小时,脑子里很多模糊的认知一下子清晰了。

不是"TPU 更好还是 GPU 更好"这种简单的问题。是两套完全不同的哲学。

GPU 是一千个大厨,TPU 是一条流水线

Henry 打了一个特别好懂的比方。

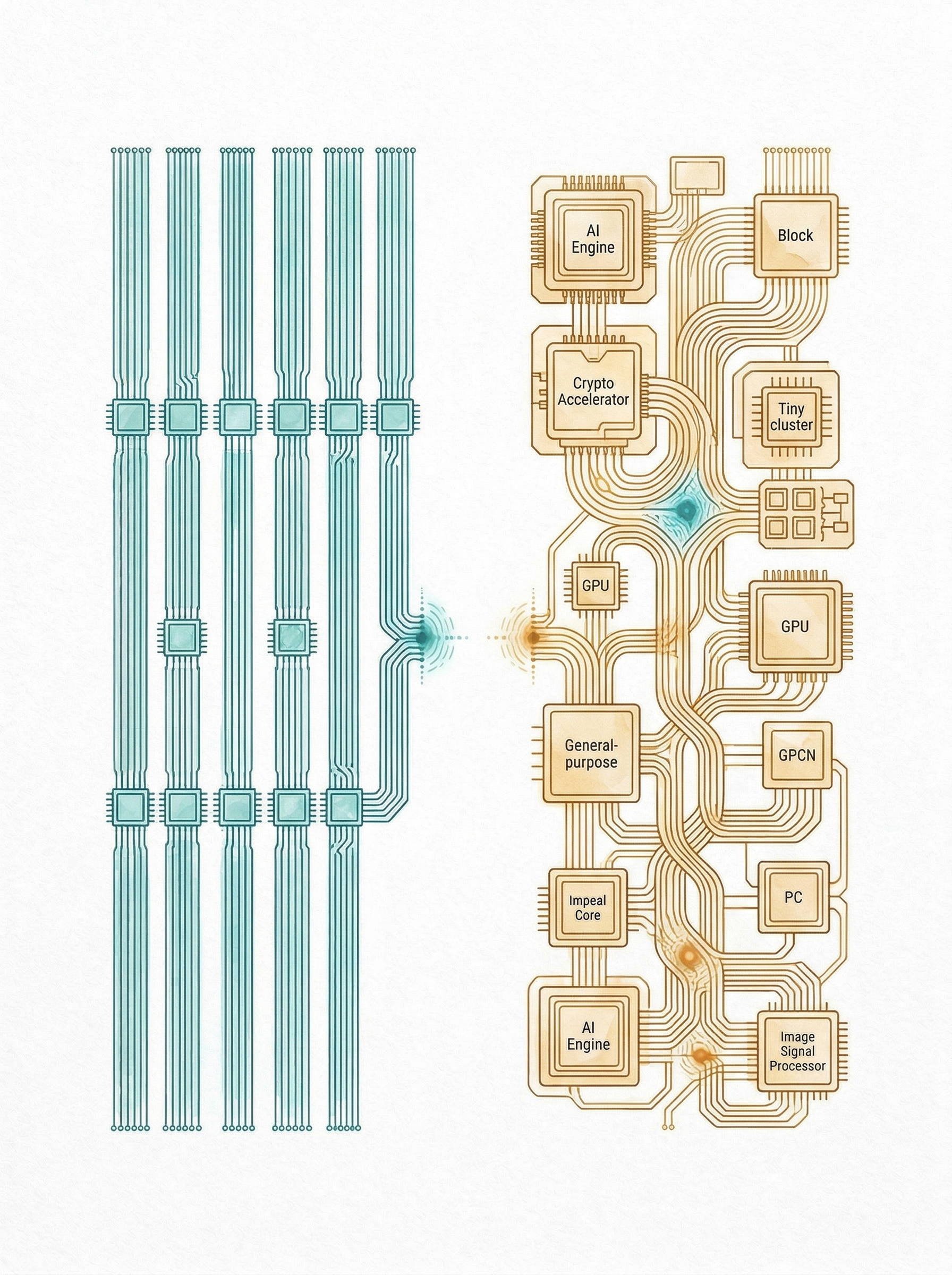

GPU 的架构叫 SIMT——Single Instruction Multiple Threading。你可以想象一个厨房里塞了一千个大厨,每个人独立思考,独立从冰箱拿食材,独立做菜,独立上菜。并行能力极强。

TPU 不一样。TPU 是一条流水线。第一个人从冰箱取菜,做完递给第二个人,第二个人加工完递给第三个人。每个人只干一件事,但中间没有等待,没有调度开销。

这个差异带来一个直接后果:GPU 的每个大厨经常在等食材从冰箱搬过来的过程中闲着。TPU 的流水线不会闲,因为软件已经把每一步的数据搬运提前安排好了。

GPU 的硬件很聪明,TPU 的硬件很蠢——但 TPU 的软件很聪明。

这句话我觉得是理解 TPU 最核心的一个切入点。

定制芯片的代价:赌对了是神器,赌错了是废铁

TPU 本质上是一款 ASIC——专用集成电路。它为矩阵计算而生,为 Transformer 而优化。

这有一个巨大的优势:当你的 workload 确定的时候,定制芯片可以把利用率拉到接近满载。Henry 说,TPU 的软件(XLA 编译器)会在全局层面做算子融合、内存管理、数据搬运规划。相当于上帝视角安排每一个计算单元每一秒该干什么。

但代价也很明确:你得赌对方向。

V4、V5 时代,TPU 的主力 workload 还是谷歌内部的推荐系统和排序算法——稀疏矩阵计算。ChatGPT 出来之后,大模型对稠密矩阵计算的需求暴涨,TPU 团队在纸面参数上一度被 GPU 拉开距离。

直到 V6、V7,他们把重心彻底转向大模型训练,参数才追了上来。

这里有个有意思的细节。Henry 说谷歌之所以能赌对 Transformer,是因为 Transformer 本身就是谷歌发明的。他们比行业外更早知道这个架构的 workload 长什么样。先发优势来自 insider knowledge。

但他也坦言自己的担忧:万一下一个范式不是 Transformer 呢?GPU 的通用性意味着它可以快速适应新算法。TPU 一旦方向错了,两到三年的芯片设计周期意味着你根本追不上。

MOE 的故事:硬件追着算法跑

一个特别能说明问题的例子是 MOE(Mixture of Experts)。

早期 TPU 用的是 2D Torus 网络拓扑——每个芯片只能跟相邻芯片通信。MOE 需要把不同的 token 路由到不同的专家,而专家分布在不同芯片上。在 2D Torus 下,你想找一个不相邻的专家,中间要经过很多跳,拥堵严重。

所以 MOE 在早期 TPU 上跑不起来。

V4 的时候,TPU 团队搞了一个 3D Torus + OCS(光纤交换机)。通过软件可编程的方式重新配置通信路径。MOE 的效率一下子上来了。

芯片设计周期两到三年,算法迭代周期六个月。 这中间的时间差,就是 ASIC 最大的风险。

真正的护城河不是芯片,是系统

听完整期播客,我最大的感受是:TPU 的竞争力不在单芯片性能,在系统。

英伟达卖的是一张一张的卡。你买了卡,还得买 NVLink、NV-Switch 这些交换机来组网。这些 infrastructure 的成本巨高。

TPU 从一开始就是按集群设计的——TPU Pod。芯片之间用铜线直连,只在关键节点用光纤交换机。用户感觉到的是"一张卡的性能",实际上背后是几千张芯片在协同。

这带来两个直接好处:

- 通信成本低。不用买昂贵的交换机。

- 训练效率高。整个系统级的优化,而不是单卡优化。

Henry 的说法是:同样训练一个 Gemini 级别的模型,TPU 的总拥有成本(TCO)比 GPU 更低。前提是你的软件栈能充分利用 TPU 的特性。

软件生态:CUDA 的护城河到底有多深

这大概是整个播客里最让我思考的部分。

CUDA 生态有多强大不用多说。全世界的 AI 研究者、工程师,默认就是 PyTorch + CUDA。成千上万的算子、库、工具链,都是围绕 CUDA 建的。

TPU 呢?你得用 JAX + XLA。

XLA 是一个静态编译器。它的好处是能做全局优化——知道整个计算图长什么样,然后在系统层面做最优调度。坏处是它是个黑盒。出了 bug,你很难 debug。

Henry 说得很直白:外部开发者很难独立修 XLA 的 bug,必须找谷歌的工程师。 这跟 CUDA 的开放生态形成了鲜明对比。

Anthropic 能用好 TPU,一个重要原因是他们的很多工程师本身就是从谷歌出来的,对 JAX + XLA 非常熟悉。苹果能用好 TPU,是因为庞若鸣(Apple Intelligence 的负责人之一)直接从谷歌把整套软件栈带过去了。

不是谁都能用好 TPU 的。你得有对的人。

如果直接在谷歌云上用 TPU 呢?Henry 给了一个让我吃惊的数字:可能只能跑到 50%-60% 的利用率。 但你付的是 100% 的钱。

这意味着,对于大多数公司来说,用谷歌云上的 TPU,性价比未必比 GPU 好。只有像 Anthropic 这种直接买 TPU 机架、有工程师能深入调优的公司,才能真正吃到 TPU 的红利。

Anthropic 的 100 万颗 TPU:内循环的力量

Anthropic 拿下 100 万颗 TPU 的订单,价值数百亿美元。这是一个巨大的数字。

但 Henry 的分析很冷静。他指出几个关键因素:

第一,Anthropic 和谷歌是深度绑定的关系。谷歌是 Anthropic 的重要投资方。这是内循环,不是纯市场行为。

第二,Anthropic 的工程团队有能力直接在 TPU 上做深度优化。据 Henry 所知,Anthropic 是目前唯一一家直接从 Broadcom 购买 TPU 机架的外部客户。其他公司——苹果、Midjourney、Meta——都还是通过谷歌云。

第三,Claude 的 API 价格大幅下降(67%),媒体把功劳归功于 TPU 训练带来的推理成本优势。

我的感受是:TPU 的外部生态扩张,目前还是高度依赖"人脉"——从谷歌出来的工程师带着知识和关系去到新公司。 这不是一个可规模化的增长模式。

Groq 的故事:另一条路

播客里还聊到了 Groq,这家公司被英伟达收购了。Groq 的创始人 Jonathan Ross 之前是 TPU 编译器团队的。

Henry 的评价很到位:Groq 本质上是一家编译器公司,不是芯片公司。 它的硬件比 TPU 还"蠢",但它的编译器可以精确到每一个时钟周期安排每个计算单元的工作。

Groq 踩准了三个时间节点:推理市场爆发、ASIC 兴起、Agent 元年。Agent 对延迟极其敏感——你的 Agent 调用链如果每一步都慢几百毫秒,整体延迟就会被拉到无法接受。Groq 的低延迟特性正好适合这个场景。

这给了我一个启发:芯片市场不会一统天下,而是会分层。 大规模训练和高吞吐推理归 GPU 和 TPU,低延迟推理和本地部署归 Groq 这类玩家,端侧归另一批。

供应链:谁也绕不开的瓶颈

一个让我特别有感触的部分是供应链。

HBM(高带宽内存)被三家公司垄断:SK Hynix、三星、Micron。英伟达是最大客户,产能提前一到两年锁定。TPU 一直是 secondary customer。

CoWoS(TSMC 的先进封装)产能也是瓶颈。谷歌做不了,Broadcom 做不了,只有 TSMC 能做。

还有良率问题。TPU 因为强调芯片间通信,对一致性要求极高。GPU 良率不好可以降级——H100 可以阉割成低配版。TPU 不行,因为每张芯片的架构是定制的,一旦不合格就报废。

再好的芯片设计,卡在供应链上就是零。

我的结论

听完这期播客,我的看法是:

TPU 不会取代 GPU,但 GPU 的垄断正在被打破。

TPU 在特定场景下——大规模部署、已知 workload、有能力做深度软件优化的团队——确实比 GPU 性价比更高。Gemini 3 用 TPU 训练登顶排行榜,不是偶然。

但 TPU 的扩张有三个硬约束:

- 软件生态。JAX + XLA 的学习曲线太陡,debug 太难。没有 CUDA 那样的开放社区。

- 供应链。HBM 和 CoWoS 产能被英伟达锁定了大部分。

- 通用性。一旦算法范式变了,两到三年的芯片设计周期意味着你可能跟不上。

对我们这些做应用层的人来说,最实际的 takeaway 是:未来的 AI 基础设施会是多元的。 GPU、TPU、Groq 这类定制芯片,各有各的生态位。不要 all-in 任何一个平台的假设。

最后,感谢硅谷101 第 228 期,主持人泓君和嘉宾 Henry 的精彩对谈。如果你对 AI 硬件感兴趣,这期值得完整听一遍。