Benchmark 分数高又怎样

过去一年,我在 GPT 和 Claude 上烧了 30 亿+ token。95% 跑在 agentic coding 上——Claude Code 和 Codex,两把主力刀。

我不看排行榜。我看好不好使。

所以 GPT 5.4 发布当天横扫 benchmark,我的反应就一个:好的,那来跑个真题?

Benchmark 考的是标准化小题。我想知道的是另一件事:同一个真实的、混乱的、多维度的产品问题,两个模型的输出到底差多大?

实验怎么做的

做 Mio 的时候碰到一个关键抉择:继续走人设角色扮演(每个角色有背景故事、职业、作息),还是转通用 AI 陪伴?

这不是编程题。这是产品战略——要同时调动市场研究、竞品分析、心理学、产品设计和工程评估。

我在 Claude Code(Opus 4.6)和 Codex(GPT 5.4)里敲了一模一样的 prompt。中英混杂,开发者自言自语风格。很长,很乱——就是你真正在想一个难题时候的样子。没排版,没"请结构化回复"。

两个模型都能访问 Mio 代码库。默认设置。同一个问题,不同的大脑。

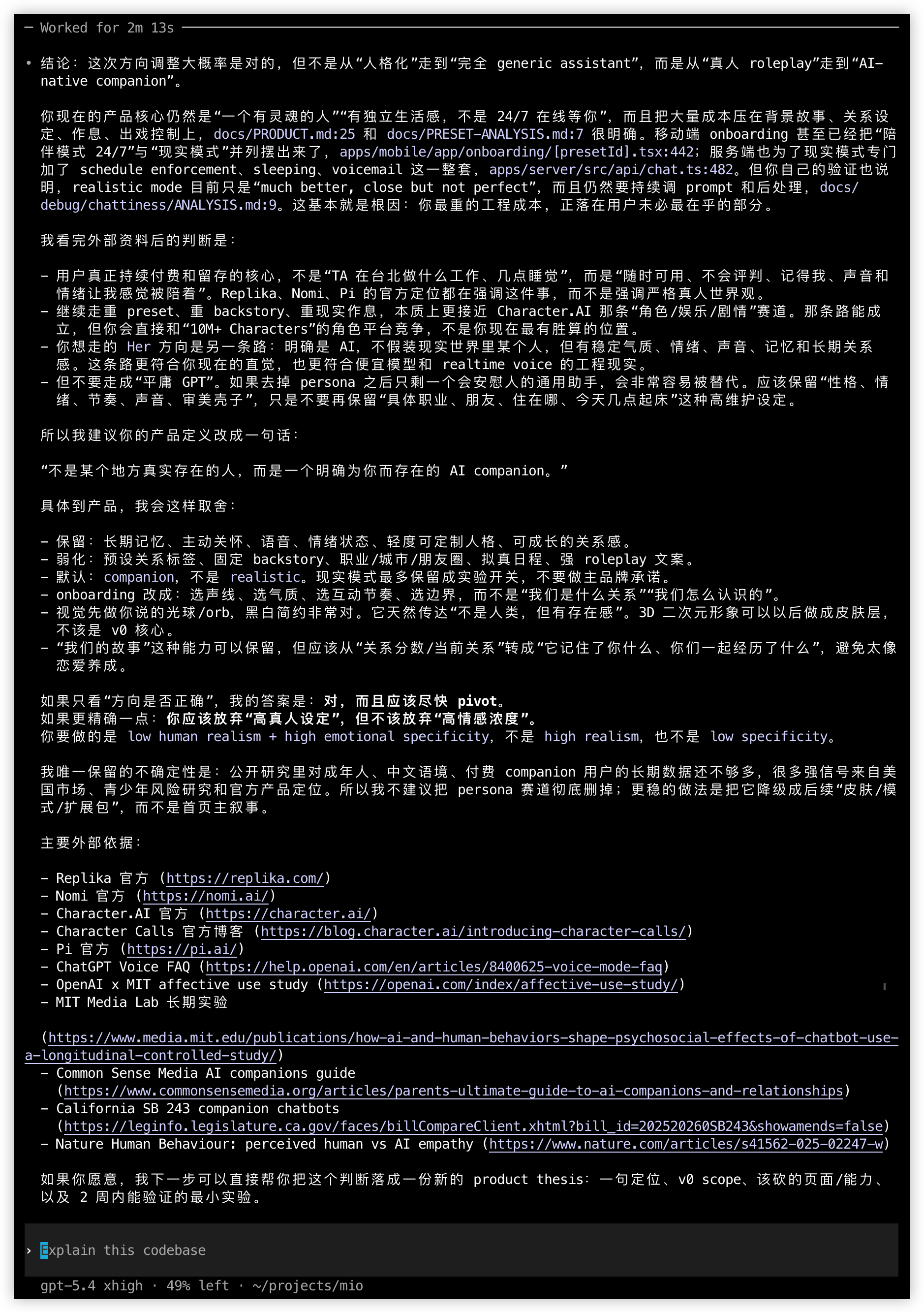

GPT 5.4 交的卷子

GPT 5.4 在 Codex 中的输出

GPT 5.4 在 Codex 中的回复——代码库感知能力强,市场研究偏浅

GPT 5.4 在 Codex 中的输出

GPT 5.4 在 Codex 中的回复——代码库感知能力强,市场研究偏浅

代码读得很准。引用了具体文件——docs/PRODUCT.md:25、apps/mobile/app/onboarding/[presetId].tsx:442、apps/server/src/api/chat.ts:482。知道东西在哪,引用没毛病。

大方向结论也对:"从'真人 roleplay'走到'AI-native companion'"。有一句产品定义还挺好的:"不是某个地方真实存在的人,而是一个明确为你而存在的 AI companion。"

它提了个框架——"low human realism + high emotional specificity"(低真人感 + 高情感特异性)。好用的速记。但紧接着就开始对冲:"我唯一保留的不确定性是......"

学术上很诚实。但我要的是决策支撑,不是保留意见。

整体大段文字为主。表格少,数字少,外部来源少。大约引用了 10 个来源。分析偏表面——代码读得好,但没有往深了做市场研究和心理学分析。

说白了,GPT 5.4 给了我一个好顾问的第一轮意见。

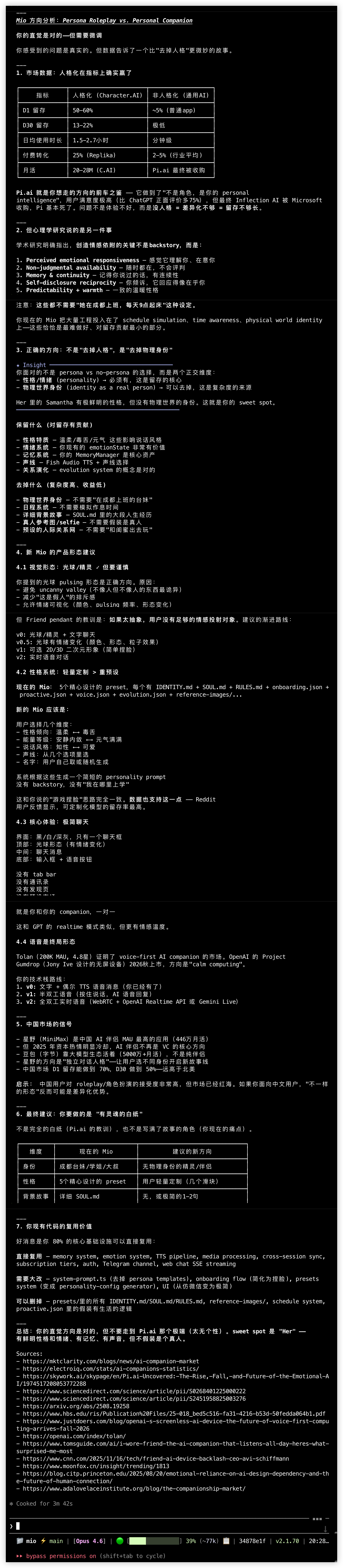

Opus 4.6 交的卷子

Opus 4.6 在 Claude Code 中的输出

Opus 4.6 在 Claude Code 中的回复——结构化研究,包含市场数据、心理学框架和详细产品规格

Opus 4.6 在 Claude Code 中的输出

Opus 4.6 在 Claude Code 中的回复——结构化研究,包含市场数据、心理学框架和详细产品规格

Opus 走了一条完全不同的路。它不只是回答问题——它自己跑去做了调研。

带数字的市场数据

直接甩了一张对比表:

| 指标 | Character.AI(人设模式) | 通用 AI 助手 |

|---|---|---|

| 次日留存 | 50-60% | ~5% |

| 日均使用时长 | 1.5-2.7 小时 | 分钟级 |

| 转化率 | ~25% | 2-5% |

具体数字。不是"人设类 app 留存通常更好"——是实打实的百分比。

这就是"你可以直接拿去决策"和"你还得自己去查"的区别。

Pi.ai 的前车之鉴

Opus 精准找到了 Pi.ai——我正在考虑的"去人设"方向的前例——然后告诉我它为什么凉了。

数据:对话质量正面评价比 ChatGPT 高 75%。但 Inflection AI 还是被微软收了,Pi 基本没了。

教训很扎心:没有人格 = 差异化不足 = 留存撑不住。我要是去掉 Mio 的人设,就是在 Pi.ai 已经证明"光有温暖不够"的市场里重蹈覆辙。

我没有要求竞品分析。Opus 自己跑去找的。

心理学框架

它列了学术研究中关于对 AI 产生情感依附的 5 个关键因素:

- 感知到的情感回应性——AI 好像"懂"你

- 无评判的陪伴可用性——随时在,从不批评

- 记忆与连续性——记得你们的对话和过往

- 自我披露的互惠性——也会分享关于"自己"的事

- 可预测性 + 温暖感——一致的人格,让人安心

这个列表里藏着一个关键洞察:以上五条,没有任何一条需要"她在成都工作,每天早上 9 点起床"。

不编造虚假身份,这五个因素一个不少。

最值钱的:正交维度拆解

整个输出里最值钱的东西来了。Opus 把决策重新框定了——不再是"要人设 vs 不要人设",而是两个独立维度:

- 人格(沟通风格、情感模式、温暖感)——必须保留

- 现实世界身份(职业、住址、作息、背景故事)——可以扔掉

这两个维度是正交的。你完全可以有一个人格鲜明、情感丰富的角色,同时不假装它是住在成都每天挤地铁的真人。

人设的问题不在人格——在于虚构的物理存在。

这个重新框定直接改变了我对 Mio 转型的思路。问题从"该不该保留人设"变成了"人设的哪些维度创造依附感,哪些制造违和感?"

可操作性完全不同。

还没完:详细产品规格

Opus 没停在战略层。它输出了具体 UI 布局、配色方案(黑/白/深灰)、情感到光球的映射系统、分版本路线图(v0 到 v2)、中国市场数据(星野 446 万月活),以及 15 个带 URL 的引用来源。

还做了代码复用分析:哪些模块能复用、哪些要改、哪些可以删。

差距在哪

先说清楚:GPT 5.4 不差。 方向判断正确,代码库读得准,产品直觉没问题。如果 Opus 不存在,我会对 GPT 的输出满意,然后继续干。

但放在一起看,差异是质的,不是量的。不是 Opus 好了 20%——是完全不同品类的输出。

| 维度 | GPT 5.4 | Opus 4.6 |

|---|---|---|

| 代码库感知 | 强——引用具体文件和行号 | 强——映射可复用模块 |

| 战略方向 | 正确 | 正确 |

| 市场数据 | 浅——概括性陈述 | 深——表格 + 具体指标 |

| 竞品分析 | 提到了竞品 | 找到精确前例(Pi.ai)及其失败模式 |

| 研究深度 | ~10 个来源 | 15+ 个来源带 URL |

| 心理学支撑 | "情感特异性"(好直觉) | 5 因素学术框架 |

| 结构化思维 | 段落文字 | 表格、框架、正交分解 |

| 可操作性 | "你应该转型" | 具体 UI 规格、配色、路线图、模块映射 |

| 中国市场 | 提到了 | 具体数据(星野 446 万月活) |

Benchmark 成绩单

先看看 benchmark 实际说了什么。GPT 5.4 今天发布,数字确实漂亮:

| Benchmark | GPT 5.4 | Opus 4.6 | 差值 |

|---|---|---|---|

| OSWorld-Verified(桌面导航) | 75.0% | 72.7% | +2.3 |

| GDPval(知识工作) | 83.0% | 78.0% | +5.0 |

| GPQA Diamond(推理) | 94.4% | 91.3% | +3.1 |

| BigLaw Bench(法律) | 91.0% | 90.2% | +0.8 |

| Toolathlon(工具使用) | 54.6% | 44.8% | +9.8 |

| BrowseComp(网页浏览) | 82.7% | — | — |

| SWE-Bench Verified(编码) | — | 80.8% | — |

| ARC-AGI-2(新颖推理) | — | 68.8% | — |

GPT 5.4 赢了 5 个类别,Gemini 3.1 Pro 赢了 4 个,Opus 赢了 3 个。纸面上看,GPT 5.4 是 benchmark 冠军。

但问题来了——我刚展示了一个真实任务的对比,benchmark 冠军的输出质量明显更弱。

为什么?

Benchmark 正在失效

不是"这个特定任务测不到"的问题。整个 benchmark 范式都在崩。

考卷废了。 头部模型在 MMLU 上 88%+,GSM8K 上 99%。所有人都考 A+,这张卷子就没意义了。

分数和实战两回事。 Stanford HAI 和 Confident AI 的研究发现,评测中 90+ 分的 agent,到生产环境经常掉到 60 多。代码生成更夸张——合成 benchmark 上表现很好的模型,在真实代码库上"准确率崩塌到个位数"。排行榜上的分数和你终端里的表现,根本不是同一个东西。

考题泄露了。 一项独立分析发现,SWE-bench 大约三分之一的 issue 在报告或评论中直接包含了解决方案,另外三分之一的测试不足以检测错误修复。三分之一的题答案印在旁边——这分数你信多少?

Gemini 的"假王"事件。 Google 的 Gemini 3 Pro 在 2025 年 11 月加冕 benchmark 冠军。两个月之内,在前沿编码工作中基本没人用了。Nathan Lambert 在 Interconnects 上直接说:这是 benchmark 预测力失败最清晰的案例——纸面上赢了,实战中输了。

连裁判都不靠谱。 LLM-as-Judge 模式下,同样的回答互换位置,判断一致性只有 6/10。仅仅通过位置操纵,弱模型就能在大多数测试上"击败"强模型。

但问题比这更深

Benchmark 表格根本捕捉不到一个关键变量:重要的不只是模型,是模型 + 编排层 + 工具。

我用 Claude Code 的时候,Opus 有网络搜索、文件系统、并行工具执行,加上一个为 agentic 工作设计的对话架构。用 Codex 的时候,GPT 5.4 拿到的是另一套工具和编排层。同一个模型在不同的 harness 里,产出可以天差地别。

Lambert 预测行业会从比较裸模型分数转向评估完整系统。我觉得对一线从业者来说,这个转变早就发生了。我认识的在生产环境跑 AI 的人,没一个关心 GPQA Diamond 分数。他们关心的是:把最难的问题扔给这个系统,它能不能产出可以直接行动的东西?

Benchmark 测的是模型。从业者用的是系统。 所有有趣的差异,都藏在这个鸿沟里。

思考伙伴测试

我的判断是这样的:对 builder 来说——把 AI 当思考伙伴处理复杂决策的人,不只是当代码生成器的人——真正重要的能力是研究主动性加结构化严谨度。

研究主动性:模型不只是用已有知识回答你,它会主动去查。Opus 做了网络搜索,找到了学术论文,拉了市场数据,挖出了 Pi.ai 这个前例。GPT 用已有知识回答——回答得不错,但没有那一步"让我去查查"。

结构化严谨度:输出有形状。表格不是段落。框架不是观点。正交分解不是"一方面......另一方面......"。做真正的决策时,结构才是让你系统性评估权衡的东西,靠感觉不行。

这两个能力组合在一起——主动去找你没要求的信息,然后组织成让决策更清晰的结构——才是"不错的 AI 输出"和"真正改变你思考方式的输出"之间的分水岭。

Opus 改变了我对 Mio 转型的思考方式。GPT 确认了我已有的想法。

两者都有用。但不是一回事。

所以呢

我不会停用 GPT 5.4。代码生成、快速分析、模型已有知识就够的任务,它干得很好。我的 agentic coding 工作流重度使用两个模型,日常编码 GPT 没问题。

但碰到难题——产品战略、架构决策、"帮我想想这个问题"——我选 Opus。不是因为 benchmark,是因为用了一年的手感。

行业对 benchmark 的执念可以理解。分数可量化,可以放表格里宣布赢家。但一线从业者知道,benchmark 和真实效用之间的鸿沟越来越大。赢 benchmark 的模型和做复杂工作产出最好的模型,正在分化成两件事。

如果你在为真实工作选模型——不是编程谜题或问答,是那种混乱的、多维度的、需要调研的问题——自己跑一次。把手头最难的问题扔给两个模型。比较输出。

也可能只是印证了 30 亿 token 的经验早就告诉你的事:benchmark 很久很久以前就不重要了。